生于云,而不止于云:平头哥镇岳SSD主控商业化加速

当新星DeepSeek以“黑马”的姿态席卷全网时,这场技术风暴远不止于社交媒体——它正以惊人的能量激活人工智能全产业链,从算法迭代到硬件革新,从应用场景到商业模式,无不经历着颠覆性重构。而这场革命的底层逻辑中,算力与存力的双重引擎正成为最核心的战场。

DeepSeek开源周第五天提出了Fire-Flyer File System,在文件系统层面对AI训练的特定场景进行了优化,可以大幅度提升SSD带宽利用率。优化的结果表明,SSD带宽利用率的提升,大幅缩短了DeepSeek模型训练时间。

“这印证了AI时代,需要更强的存力来提升AI训练效率”。在MemoryS 2025存储峰会上,平头哥半导体产品总监周冠锋这样表示。而在会上平头哥展示的代表先进AI存力的镇岳510主控芯片得到了广泛关注。

平头哥半导体产品总监周冠锋

率先实现随机写破百万时间回到2024年末,网络上出现了一款企业级SSD(忆恒创源PBlzae7 7A40)的测试,最吸睛的是高达百万级IOPS的稳态4KB随机写入成绩——这恐怕是常规(非计算存储)TLC SSD的最强随机写入性能了,相较之下,绝大多数SSD的随机写IOPS不超过50万。

当然,对于TLC SSD能够达到百万级随机写这个事情,我们认为是迟早的事情,能够在PCIe 5.0时代看到这个突破还是蛮惊喜的。毕竟这些年SSD的性能就是这样一步一步发展上来的。增加主控通道和CE的数量、增加NAND介质的Plane数量(主流TLC NAND Die的Plane已经从2个发展到4个,部分较新的型号达到6个,甚至8个。针对SCM的SLC/MLC NAND Die还会设计更多的Plane。)都可以增加并行操作的规模,从而提高峰值性能。

细看测试数据之后,真正让我们感到惊奇的其实是浅队列的随机写性能,仅仅在队列为1的情况下,就超过了20万IOPS!这意味着随机写的时延不到5μs!通常PCIe 5.0 SSD的随机写时延在8μs左右,拉开性能差距的主要是随着队列深度增加,性能逐步达到峰值的高低有别。这个前所未有的低时延表现就不由得让我们对SSD主控充满了好奇:这是一款什么样的主控?它到底是如何压缩写时延的?

PBlzae7 7A40的主控其实还真是个市场上的新面孔:镇岳510,来自平头哥半导体。

出道即登峰镇岳510的首次亮相是在2023云栖大会上,该款芯片为云计算场景做了深度定制。发布时镇岳510的一大亮点便时率先实现了4μs超低时延,比业界主流降低30%以上。不过当初业内对这个数值确实关注度不高,直到搭载镇岳510的商业化SSD出现,大家才对“4μs”这个指标有了直观且震撼的感受。

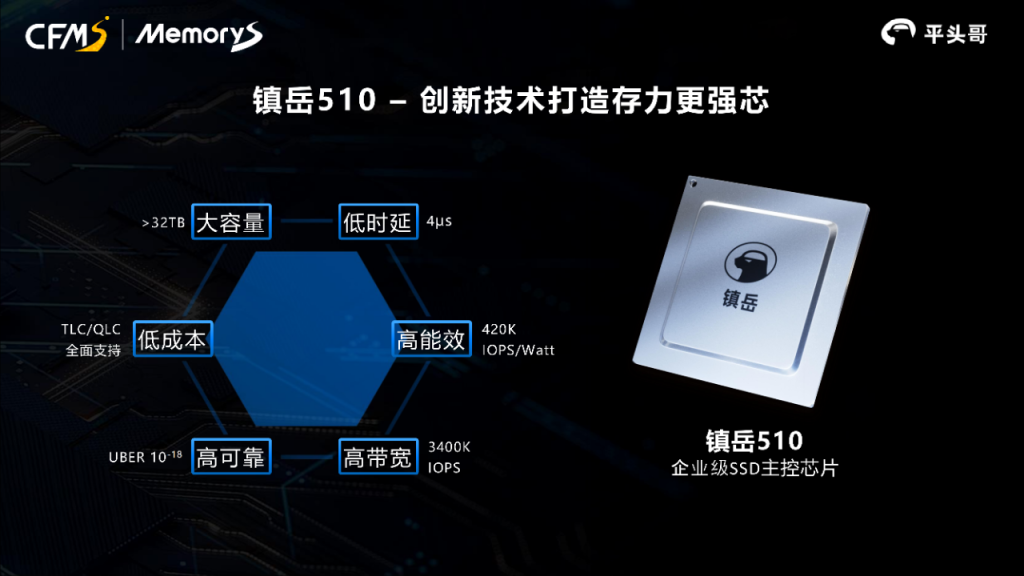

在这里我们先简要复述一下镇岳510的基本规格信息。镇岳510采用平头哥自研的芯片架构,支持PCIe 5.0 x4单端口,内置玄铁R910RISC-V多核CPU系统,最高频率1.6GHz,关键数据通路与命令通路大量采用定制硬件模块加速。镇岳510支持DDR ECC,最大DRAM容量32GB,速率支持DDR4-3200MT/s、DDR5-5200MT/s。NAND介质方面,支持16通道,支持1xx层/2xx层 TLC/QLC,支持ONFI 4.2和Toggle 5.0接口。协议方面,支持NVMe 1.4b、ZNS、CMB、Multi-Namespace等。

镇岳510标称的顺序读带宽14GB/s,顺序写10GB/s,随机读340万IOPS,随机写250万IOPS。QD1读时延小于67μs,QD1写时延小于4μs。

硬件加速实现超低时延现在回顾镇岳510的规格,它实现4μs超低时延的秘密就是“大量采用定制硬件模块加速”。

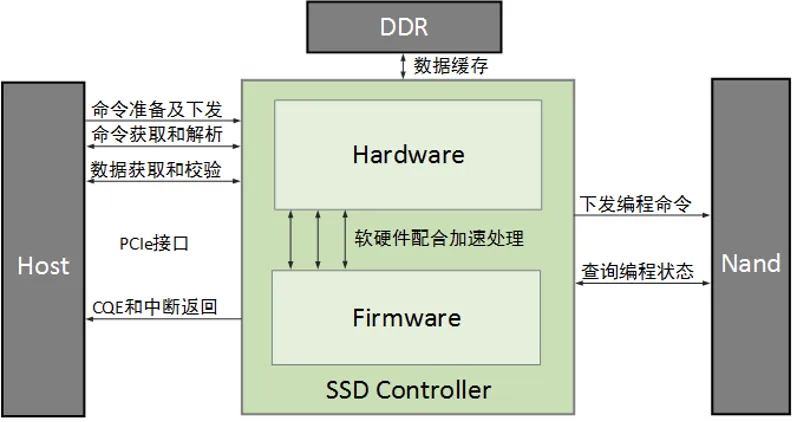

其实,SSD的随机写时延并不包括NAND内部的编程时间(典型值约500μs量级),而是在SSD主控收到写入数据,分配写入地址并依此改写FTL表后,便向主机返回写入完成的状态。从主机发出指令,到状态返回,其中的时间主要是主机、内存、SSD主控通过PCIe多次交互的过程,写入介质的时间被隐藏在后台。

在写入操作中,从指令到FTL改表之间,需要进行几个操作:命令准备(主机-内存)、命令获取(主机-内存;主机-PCIe-SSD主控)、命令解析(SSD主控)、地址解析(SSD主控)、数据获取(SSD主控-PCIe-内存)、FTL改表(SSD主控)。

在以上过程中,命令准备、命令获取、数据获取这几步,其中主机的内存、PCIe多次交互,每次时延在100ns到500ns之间。SSD主控能够影响的是命令获取、命令解析、地址解析、FTL改表,以及状态返回。

上述几个指令步骤,以及队列管理、缓存管理等工作,大部分SSD主控是通过Firmware编程处理,控制主控硬件执行。在镇岳510中,这些工作全部交由专用的硬件加速器实现,不再需要Firmware参与,除非在某个环节检测到异常。Firmware和通用核可以处理更复杂的问题,当异常出现时,可以由Firmware介入。如此一来,正常场景下的操作都直接在硬件加速器中完成,避免了Firmware主导带来的软硬件交互开销,时延和功耗都会明显降低。

优秀的算法创新除了命令解析、地址解析等操作,平头哥团队为镇岳510开发的创新算法和加速器还有不少。

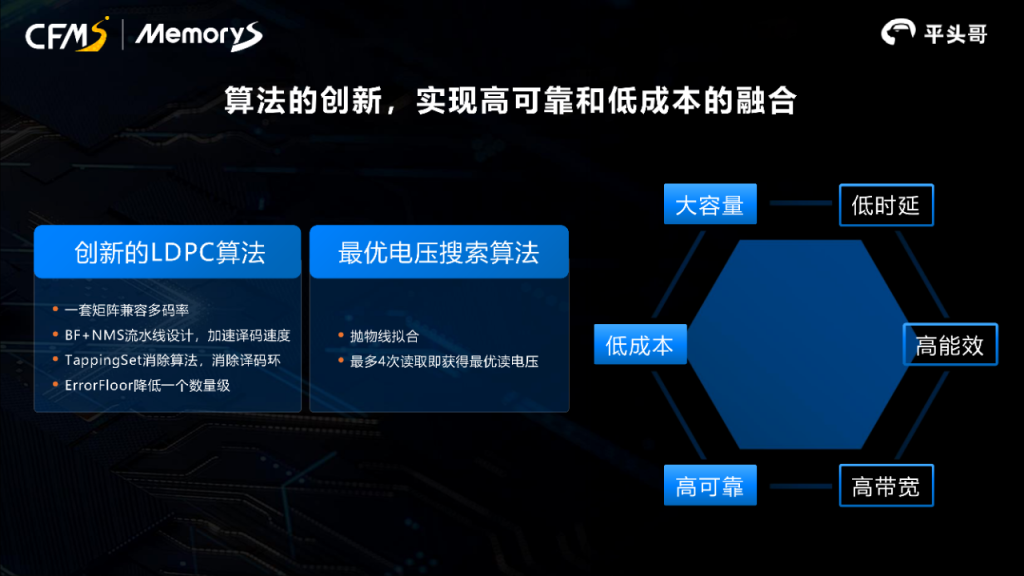

譬如针对数据纠错,SSD主控普遍采用了LDPC(Low Density Parity Check Code)算法,纠错性能强,而且由于逼近香农极限,可以传输更多的有效数据。但是LDPC的计算复杂度较高,对硬件实现带来了较高的挑战。平头哥通过对校验矩阵H的构造方法进行全新设计,将BF+NMS算法做流水线整合,既保留了BF的高速率,还保留了NMS算法的高纠错能力,同时最大化消除了LDPC算法中的译码环。镇岳510的校验矩阵设计还做了特殊的处理,使得用一套矩阵可以兼容多种码率,这意味着一套矩阵可适配不同的NAND介质,利用SSD的开发。

镇岳510集成了自研的介质电压预测算法,可以在不同工况下预测闪存电压漂移。这使得尽可能少的尝试即可获得适宜的读取电压,有利于降低时延、改善QoS,也进一步降低LDPC解码器的输入误码率,

改良的LDPC算法和电压预测算法也都是在专用硬件加速器中完成。这些算法,配合盘内RAID,镇岳510的UBER(Uncorrectable Bit Error Rate)指标可以达到10–18,相当于百亿亿笔数据才可能有一笔数据出错。这一数字相对业内标杆提高了整整一个数量级,更好的保障了企业级SSD的数据可靠性需求。

阿里云的规模部署验证

镇岳510于2023年量产,现已在阿里云上规模上线部署。在性能、能效、稳定性等方面都获得了验证。

性能:基于镇岳510的SSD顺序读带宽可以达到14GB/s,顺序写带宽10GB/s以上,随机读IOPS可以达到340万以上。高性能可以大幅提升阿里云EBS(弹性块存储)业务的带宽、IOPS,提供更好的服务能力。

能效:基于镇岳510的SSD功耗处于主流水平,得以实现42万IOPS/W的高能效,有利于节省运营成本。

服务水平:根据我们的经验,较高的随机写IOPS、较低的写时延,对混合读写的测试表现有利。来自阿里云EBS的实测数据也验证了这一点:镇岳510的99.99%长尾时延相比友商SSD降低了92%。在分布式系统中,长尾时延直接影响集群服务的平稳,过高的时延会带来明显的波动。为了控制长尾时延,通常只能降低该系统的负载。镇岳510大幅降低长尾时延带来的直接效益就是允许增加系统负载,可以提供更好的用户体验,提升SLA(Service Level Agreement,服务级别协议)。

镇岳510提升QoS的手段可不仅仅是靠读写性能高,还有很多的细节。譬如底层的IO优先级调度就很好地体现了来自云服务厂商的业务理解。NVMe规范中定义调度机制是按队列调度,同一队列优先级相同。镇岳510实现了基于IO粒度的优先级调整,可以更为灵活地为IO独立设置优先级标签,更好地保障延迟敏感型IO的SLA。

镇岳510还支持ZNS协议,让数据排布根据业务优化,减少写入放大和垃圾回收时的数据移动。ZNS的Zone分区状态由玄铁R910通用核负责维护。

来自AI、金融行业的严苛要求

CFMS 2025中,我们看到忆恒创源、得瑞领新、佰维正在基于镇岳510开发企业级SSD解决方案,相关产品陆续上市。这也代表着镇岳510的产业化之路进入了第二个阶段:从阿里云走向外部,以满足广大企业级/数据中心用户的需求。从本文开篇提到的测试成绩看,镇岳510与外部合作伙伴的第一款产品表现相当惊艳,无愧于PCIe 5.0 SSD当中的佼佼者,尤其适合当前对于高性能、高可靠性SSD有迫切需求的领域,如AI、金融等。

以AI工作流为例,在数据准备阶段,大量数据需要被清洗、格式化,对SSD的读、写性能均衡。数据准备阶段可以占到整个预训练阶段三分之一的时间,是一个大量消耗通用算力和反复读写存储集群的过程。镇岳510的写性能优势在这个阶段可以体现出价值。

在训练阶段,需要频繁读取已经处理好的数据。这个阶段的数据量其实并不大,通常完全加载到节点内部的SSD中。使用镇岳510主控的SSD可以提供高达14GB/s的顺序读,以及400万IOPS以上的随机读性能——尽可能高的读性能有利于节约GPU时间。

检查点的创建与恢复会导致昂贵的GPU时间陷入空闲,因此希望尽可能快速地完成检查点操作。随着集群规模越来越庞大,训练故障愈发频繁,检查点创建的时间间隔不断缩短,已经从早期的数小时调整至15分钟之内。检查点的创建可先从GPU显存复制到DRAM或本地SSD缓存盘,再异步写入存储集群。如果写入SSD缓存盘,顺序写性能越高越好,此时镇岳510提供的10GB/s以上的顺序写性能可以有效减少GPU的等待时间。

在大模型的部署阶段,微调和RAG是访问强度比较高的环节。微调的需要与数据准备、训练阶段是类似的,只是规模会小一些。RAG通常需要配合向量数据库,在嵌入后,向量数据库的容量会增加到原始数据的数倍甚至十倍以上。镇岳510超高的随机访问性能,可以帮助压缩首Token的生成时间。

在行业应用场景中,比如对于金融行业而言,对存储系统的要求不仅是性能高,还有严苛的可靠性要求。

金融行业的数据库规模远大于AI训练集群,通常使用分布式数据库,要求具有高可用性和强大并发处理能力。镇岳510提供的超高读写带宽、超高的随机读写性能均有利于提高分布式数据库的并发事务吞吐量。尤其值得一提的是,前面曾经提到过的长尾时延指标在分布式系统中尤其重要,否则任何交易数据因为落盘时间意外过长,都有可能导致集群出现抖动,严重的可能导致后续业务的拥塞。

上一段是从性能,或者说“硬实力”的角度去看镇岳510如何满足金融行业高并发、高可用性的需求。其实镇岳510还有诸多“软实力”进一步为高可用性目标保驾护航。譬如,镇岳510可以IO为单位,按照存储语义校验,支持在线校验、支持后台巡检。后台巡检不需要将数据读出到服务器,可以减少CPU算力、内存带宽、PCIe带宽的浪费,更重要的是,巡检可以预防SSD数据出现静默错误。对于强调高可用性的存储系统而言,即使单盘故障不会导致数据丢失,但重建依旧会影响集群性能。

结语

镇岳510作为一款要完全跑通产业化、商业化的产品,用一年多的时间,在阿里云内部获得了规模化的、充分的验证,证明除了云服务、AI外,其顶尖性能对高性能企业存储(AI、OLTP等)也有很大的吸引力。

在CFMS 2025中,我们很高兴地看到镇岳510合作伙伴正在不断壮大,与会者对于这一全新方案展现出来的技术实力充满热情与期许。不论是AI训练与落地的热潮,亦或是主控+介质的合作共赢,我们期待镇岳510的顶级性能不负时代。